MIRAR: ¿Se ha politizado la inteligencia artificial? Así es como progresa la carrera mundial para desarrollar esta tecnología.

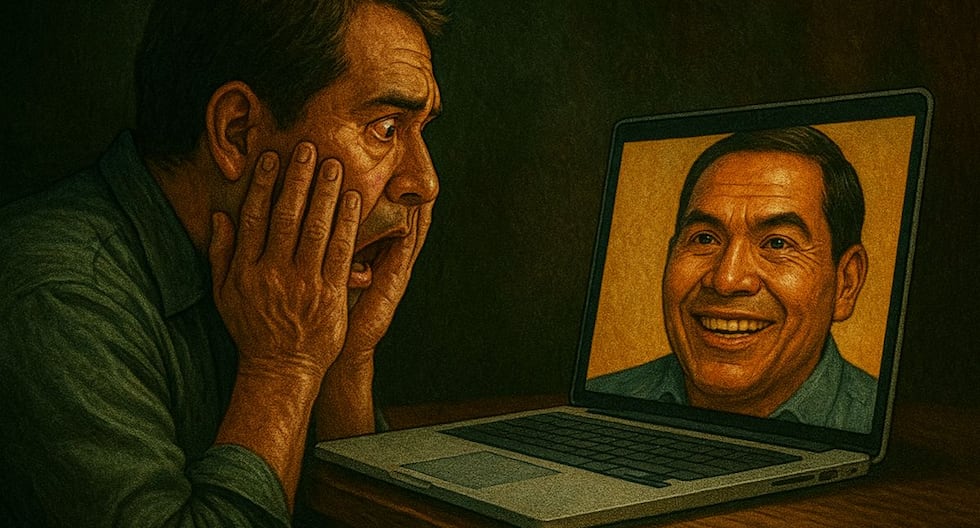

Y es que, junto con todas las ventajas que nos ha traído una inteligencia artificial generativa, también ha ampliado las capacidades de los cibercriminales para llevar a cabo sus estafas con herramientas cada vez más sofisticadas para engañarnos como los ‘profundos’, imágenes creadas por AI que emulan personas reales. Es precisamente la propagación de estas imágenes lo que nos ha motivado a escribir esta nota, una guía básica sobre lo que las cosas tienen en cuenta saber si nos enfrentamos a tal fraude.

Boletín exclusivo para suscriptores

¿Qué es un ‘Deepfake’?

«Un ‘Deepfake’ es una alteración digital de una imagen, un video o un audio que utiliza inteligencia artificial con la intención de suplantar la identidad de otra en alguna acción o escenario«, Dijo un Comercio Leandro Cuzzo, analista de seguridad en el equipo global de investigación y análisis para América Latina en Kaspersky. «Se trata de usar la ingeniería social para engañar a una persona o un grupo de personas que están frente a una persona, ser alguien conocido o alguien famoso, tener acceso a datos confidenciales, contraseñas, credenciales o cuentas bancarias en varios servicios o alentarlos a invertir en algo como una criptomoneda».

Poco después de la elección del Papa Leo XIV, comenzaron a extenderse en los falsos discursos de Tiktok y YouTube del pontífice con inteligencia artificial.

/El experto dividió las estafas en dos elementos en trazos amplios:

- Suplantación de celebridades o figuras públicas para incitar inversiones falsas o robo de credenciales. Un ejemplo de esto fue el caso de Una mujer argentina que fue engañado por un falso George Clooney para colaborar monetariamente en las actividades del club de fanáticos del actor, perdiendo alrededor de US $ 15 mil.

- Usurpación del usuario del usuario para abrir cuentas en billeteras virtuales y solicitar préstamos.

Es el primero de estos que nos enfocaremos en este artículo, buscando que el usuario esté más preparado para identificarlos y no caer en estos engaños. Sin embargo, una forma de protegernos del segundo caso, la suplantación de la identidad, Está restringiendo la cantidad de información personal, fotos y videos que uno comparte en línea y en las redes socialesPor ejemplo, limitar solo a amigos y familiares que pueden visualizarlo. Esto dará menos información a los ciberdelincuentes que quieran imitarnos a través de un ‘profundo’.

¿Qué estar atento?

Si bien anteriormente tenían signos más claros de que una imagen, un video o un audio había sido manipulado por la inteligencia artificial, los nuevos avances tecnológicos han causado que estos errores se reduzcan para crear imágenes casi perfectas. De todos modos, siempre es importante saber qué características se atentan tanto porque muchos de los cibercriminales no tienen acceso a las herramientas más sofisticadas sin errores.

Aquí hay factores a tener en cuenta según El laboratorio de medios del MIT y Otros sitios especializados:

Fotos

- Mira las manos. ¿Es correcto el número de dedos? También observe si son los dedos adecuados y no hay más de un pulgar por mano.

- Mirar la caraDado que las manipulaciones de ‘Deepfake’ son casi siempre transformaciones faciales, por lo que una imagen borrosa en los bordes de la cara puede señalar que la imagen ha sido manipulada.

- Presta atención a las mejillas y la frente. ¿La piel se ve demasiado suave o demasiado arrugada? ¿Es el envejecimiento de la piel similar al cabello y los ojos? ¿Las facciones son congruentes con el resto de la cara?

- Mire la tez y si es consistente con el sujeto. Una diferencia de color entre la cara y el resto del cuerpo puede indicar un ‘profundo’ (o un bronceado desigual).

- Observe cuidadosamente los ojos y las cejas. ¿Aparecen las sombras en los lugares esperados? ¿Brillan mucho?

- Si el sujeto usa anteojos: ¿hay algún reflejo? ¿Hay demasiada reflexión?

- Revise cuidadosamente el vello facial o la falta de la misma. ¿Este cabello facial se ve real? Los defectos profundos pueden agregar o eliminar bigotes, alfileres y barbas, pero es posible que no se vea natural.

- Presta atención a los lunares faciales u otras marcas. ¿Parecen reales?

- Analizar la parte inferior de las imágenes. ¿Son consistentes las formas con la iluminación? ¿Las estructuras u objetos parecen distorsionadas o sospechosamente inclinadas? Si hay otras personas en el fondo, revise otras señales de que la imagen ha sido manipulada por la inteligencia artificial.

Captura de un video ‘Deepfake’ publicado por Donald Trump en el que el presidente estadounidense Barack Obama es encarcelado. Foto: Donald Trump/Truth Social

Videos

En el caso de los videos, todas las consideraciones pasadas relacionadas con las fotos son relevantes, pero el video presenta más oportunidades para encontrar inconsistencias que pueden marcar el material como se manipula con IA.

- Mira los movimientos de los labios. Algunos ‘profundos’ se basan en la sincronización de labios. ¿Los movimientos de los labios parecen naturales? ¿Coinciden con las palabras que dicen?

- Volver a las marcas lunares y faciales, busca consistencia ¿Se quedan en el mismo lugar durante todo el video?

- Los reflejos son reporteros: Si el objeto del video tiene gafas, ¿cambia el ángulo del reflejo cuando la persona se mueve? Una vez más, los ‘profundos’ son completamente difíciles de hacer la física natural de la iluminación.

- Presta atención a Flicker. ¿La persona parpadea lo suficiente o demasiado?

- Mira los dientes. Si se ven borrosos o la forma se mantiene en todo el video puede ser una señal de defake profundo.

- Verifique la expresión de las personas. ¿Se ve natural o artificial? ¿Es demasiado neutral? ¿Estás de acuerdo con lo que dice la persona?

- Si hay otros objetos en el video, ¿respetan las leyes de la física? Los buques de agua donde el líquido actúa sospechosamente también son posibles signos de un ‘defake’.

Aquí un ejemplo, en inglés, un ‘Deepfake’ de Bill Gates. Presta atención a tus labios borrosos:

Audio

Los audios son otra rama del ‘Deepfake’ que también puede ser engañoso al no darnos pistas visuales, pero todavía hay algunas señales que pueden decirnos si nos enfrentamos a un ‘profundo’ o no.

- Diálogo monótono. Todavía tiene dificultades para hablar naturalmente como humano, lo que puede revelar su naturaleza artificial, por ejemplo, cambiando el tono para insinuar una pregunta cuando no hay ninguna o contar una historia emocional sin aparentemente tener una respuesta emocional.

- Hablar mal articuladoespecialmente en términos poco comunes. Debido a que los ‘profundos’ auditivos se realizan analizando el discurso de la persona, la inteligencia artificial puede tener problemas para articular palabras que no tiene en sus bases de datos lo que puede conducir a dificultades de pronunciación o pausas sospechosas.

- Sonidos extraños. Preste atención a sonidos extraños como interferencia o estática, especialmente cuando se trata de mensajes de personas que acceden lógicamente a herramientas profesionales como actores o políticos.

¿Pueden ayudarnos los programas de detección?

Si el problema de ‘Deepfakes’ es tecnología, ¿puede la solución también provenir de la tecnología? Por lo tanto, con la difusión de más y más imágenes generadas por AI también ha llevado a la creación de herramientas, gratuitas y pagadas, para detectar su manipulación de computadora utilizando una serie de algoritmos.

Sin embargo, como nos advierte Leandro Cuzzo de Kaspersky, el nivel de certeza de este tipo de herramientas sigue siendo sospechoso y muchos de ellos pueden identificar algo verdadero y viceversa.

«Todavía no tienen un gran radio de detección, pero mejorará con el tiempo»dijo el experto. «Es una competencia entre creadores y detectores de ‘Deepfakes'».

En cierto modo, dependiendo de estas herramientas también puede ser un talón de Aquiles para sus usuarios, dándoles certezas cuando aún deberían tener dudas. Es por eso que lo más importante para detectar ‘Deepfakes’ sigue siendo el humano y su capacidad para razonar.

Lo más importante: el contexto

«Lo que más recomiendo para tratar de detectar hoy es analizar más el contexto que la imagen, el video o el audio en sí», dijo el experto. «Por ejemplo, si alguien me sucede un video donde Elon Musk, en un español perfecto, me dice que debo invertir s/. 100 mil y me devolverá cinco veces que mi inversión es algo para tener precaución y pensar que es un video que ha sido manipulado. Por qué? Porque Elon Musk no habla el español perfecto, no hay inversiones que regresen el quintúculo de lo que invierte y bien, es una oferta muy rara.

Por lo tanto, el experto en ciberseguridad recomendó cuatro factores que uno debe tener en cuenta al recibir un audio, video o fotografía sospechosa.

- Siempre verifique la fuente y el remitente. ¿Es confiable? ¿Es oficial? Incluso en esto debemos tener cuidado porque se han producido casos en los que los cibercriminales han tomado el control de las cuentas oficiales para difundir su fraude.

- Analizar el contexto: ¿Qué pide el mensaje? ¿Cómo lo dices? ¿Qué emociones intentan causar? Las ciberdelincuentes muchas veces quieren generar una sensación de prisa para que sus víctimas cometan errores.

- Desconfianza si solicitan datos confidenciales como contraseñas o información bancaria. Ningún banco le solicitará esta información o correo y se puede sospechar de cualquier pariente o celebridad que lo desee (ya sea un ‘profundo’ o no).

- Sospecha que si ofrece algo demasiado bueno para ser verdad. Si hay una inversión tan buena para duplicar su inversión, ¿por qué la difundirían en lugar de obtener todos los beneficios para ellos?

Con estos consejos, cuán preparado para detectar ‘Deepfake’ siente. Puedes probar tus habilidades con El próximo cuestionario de la Universidad del Noroeste.